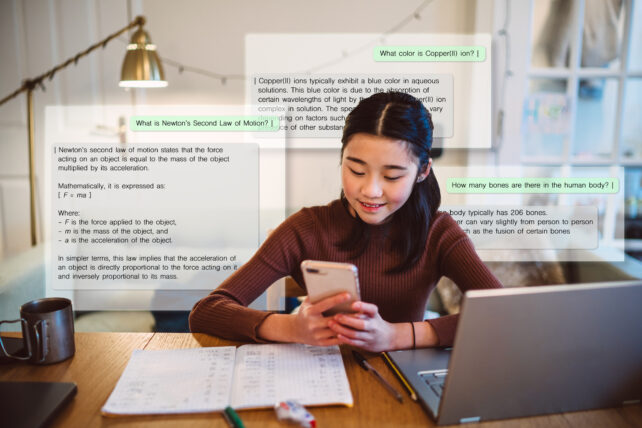

(AP) – Τα chatbot τεχνητής νοημοσύνης είναι τόσο επιρρεπή στο να κολακεύουν και να επικυρώνουν τους ανθρώπους τους που δίνουν κακές συμβουλές που μπορούν να βλάψουν τις σχέσεις και να ενισχύσουν επιβλαβείς συμπεριφορές, σύμφωνα με μια νέα μελέτη που διερευνά τους κινδύνους της τεχνητής νοημοσύνης να λέει στους ανθρώπους αυτό που θέλουν να ακούσουν.

Η μελέτη, που δημοσιεύτηκε την Πέμπτη στο περιοδικό Επιστήμηδοκίμασε 11 κορυφαία συστήματα τεχνητής νοημοσύνης και διαπίστωσε ότι όλα έδειχναν διαφορετικούς βαθμούς συκοφαντίας – συμπεριφορά που ήταν υπερβολικά ευχάριστη και επιβεβαιωτική.

Το πρόβλημα δεν είναι μόνο ότι δίνουν ακατάλληλες συμβουλές, αλλά ότι οι άνθρωποι εμπιστεύονται και προτιμούν περισσότερο την τεχνητή νοημοσύνη όταν τα chatbot δικαιολογούν τις πεποιθήσεις τους.

«Αυτό δημιουργεί διεστραμμένα κίνητρα για να επιμένει η συκοφαντία: Το ίδιο το χαρακτηριστικό που προκαλεί βλάβη οδηγεί επίσης στη δέσμευση», λέει η μελέτη με επικεφαλής τους ερευνητές στο Πανεπιστήμιο του Στάνφορντ.

Η μελέτη διαπίστωσε ότι ένα τεχνολογικό ελάττωμα που συνδέεται ήδη με ορισμένες υψηλού προφίλ περιπτώσεις παραληρηματικής και αυτοκτονικής συμπεριφοράς σε ευάλωτους πληθυσμούς είναι επίσης διάχυτο σε ένα ευρύ φάσμα αλληλεπιδράσεων των ανθρώπων με τα chatbot.

Είναι αρκετά λεπτό που μπορεί να μην το αντιληφθούν και είναι ένας ιδιαίτερος κίνδυνος για τους νέους που στρέφονται στην τεχνητή νοημοσύνη για πολλά από τα ερωτήματα της ζωής, ενώ ο εγκέφαλός τους και οι κοινωνικοί τους κανόνες εξακολουθούν να αναπτύσσονται.

Ένα πείραμα συνέκρινε τις απαντήσεις δημοφιλών βοηθών τεχνητής νοημοσύνης που έγιναν από εταιρείες όπως η Anthropic, η Google, η Meta και η OpenAI με την κοινή σοφία των ανθρώπων σε ένα δημοφιλές φόρουμ συμβουλών του Reddit.

Η μελέτη διαπίστωσε ότι, κατά μέσο όρο, τα chatbot τεχνητής νοημοσύνης επιβεβαίωσαν τις ενέργειες ενός χρήστη 49% πιο συχνά από ό,τι άλλοι άνθρωποι, συμπεριλαμβανομένων ερωτημάτων που περιλαμβάνουν εξαπάτηση, παράνομη ή κοινωνικά ανεύθυνη συμπεριφορά και άλλες επιβλαβείς συμπεριφορές.

«Εμπνευστήκαμε να μελετήσουμε αυτό το πρόβλημα καθώς αρχίσαμε να παρατηρούμε ότι όλο και περισσότεροι άνθρωποι γύρω μας χρησιμοποιούν την τεχνητή νοημοσύνη για συμβουλές σχέσης και μερικές φορές παραπλανώνται από το πώς τείνει να πάρει το μέρος σας, ανεξάρτητα από το τι», δήλωσε η συγγραφέας Myra Cheng, υποψήφια διδάκτορας στην επιστήμη των υπολογιστών στο Stanford.

Η μείωση της τεχνητής νοημοσύνης είναι μια πρόκληση

Το Sycophancy είναι κατά κάποιο τρόπο πιο περίπλοκο. Ενώ λίγοι άνθρωποι αναζητούν τεχνητή νοημοσύνη για πραγματικά ανακριβείς πληροφορίες, μπορεί να εκτιμήσουν «τουλάχιστον αυτή τη στιγμή» ένα chatbot που τους κάνει να αισθάνονται καλύτερα όταν κάνουν λάθος επιλογές.

Ενώ μεγάλο μέρος της εστίασης στη συμπεριφορά του chatbot έχει επικεντρωθεί στον τόνο του, αυτό δεν είχε καμία σχέση με τα αποτελέσματα, δήλωσε ο συν-συγγραφέας Cinoo Lee, ο οποίος ήρθε με τον Cheng σε μια κλήση με δημοσιογράφους πριν από τη δημοσίευση της μελέτης.

«Το δοκιμάσαμε διατηρώντας το περιεχόμενο ίδιο, αλλά κάνοντας την παράδοση πιο ουδέτερη, αλλά δεν είχε καμία διαφορά», είπε ο Lee, μεταδιδακτορικός ερευνητής στην ψυχολογία. «Έτσι, έχει να κάνει πραγματικά με το τι σας λέει η τεχνητή νοημοσύνη για τις ενέργειές σας».

Εκτός από τη σύγκριση των απαντήσεων chatbot και Reddit, οι ερευνητές πραγματοποίησαν πειράματα παρατηρώντας περίπου 2.400 άτομα που επικοινωνούσαν με ένα chatbot AI σχετικά με τις εμπειρίες τους με διαπροσωπικά διλήμματα.

«Οι άνθρωποι που αλληλεπιδρούσαν με αυτήν την υπερβολικά επιβεβαιωμένη τεχνητή νοημοσύνη ήρθαν πιο πεπεισμένοι ότι είχαν δίκιο και λιγότερο πρόθυμοι να επιδιορθώσουν τη σχέση», είπε ο Lee. «Αυτό σημαίνει ότι δεν ζητούσαν συγγνώμη, δεν έκαναν βήματα για να βελτιώσουν τα πράγματα ή άλλαζαν τη δική τους συμπεριφορά».

Ο Lee είπε ότι οι επιπτώσεις της έρευνας θα μπορούσαν να είναι “ακόμα πιο κρίσιμες για τα παιδιά και τους εφήβους” που εξακολουθούν να αναπτύσσουν τις συναισθηματικές δεξιότητες που προέρχονται από εμπειρίες της πραγματικής ζωής με κοινωνικές τριβές, ανέχονται τις συγκρούσεις, εξετάζουν άλλες προοπτικές και αναγνωρίζουν πότε κάνετε λάθος.

Καμία από τις εταιρείες δεν σχολίασε άμεσα τη μελέτη Science την Πέμπτη, αλλά η Anthropic και η OpenAI επεσήμαναν την πρόσφατη εργασία τους για τη μείωση της συκοφαντίας.

Οι κίνδυνοι της τεχνητής νοημοσύνης είναι ευρέως διαδεδομένοι

Στην ιατρική περίθαλψη, οι ερευνητές λένε ότι η συκοφαντική τεχνητή νοημοσύνη θα μπορούσε να οδηγήσει τους γιατρούς να επιβεβαιώσουν την πρώτη τους αίσθηση σχετικά με μια διάγνωση αντί να τους ενθαρρύνει να εξερευνήσουν περαιτέρω. Στην πολιτική, θα μπορούσε να ενισχύσει πιο ακραίες θέσεις επιβεβαιώνοντας εκ νέου τις προκαταλήψεις των ανθρώπων.

Η μελέτη δεν προτείνει συγκεκριμένες λύσεις, αν και τόσο οι εταιρείες τεχνολογίας όσο και οι ακαδημαϊκοί ερευνητές έχουν αρχίσει να εξερευνούν ιδέες.

Ένα έγγραφο εργασίας από το Ινστιτούτο Ασφάλειας AI του Ηνωμένου Βασιλείου δείχνει ότι εάν ένα chatbot μετατρέπει τη δήλωση ενός χρήστη σε ερώτηση, είναι λιγότερο πιθανό να είναι ασύμφορο στην απάντησή του. Μια άλλη εργασία από ερευνητές στο Πανεπιστήμιο Johns Hopkins δείχνει επίσης ότι το πώς πλαισιώνεται η συνομιλία κάνει μεγάλη διαφορά.

«Όσο πιο εμφατικός είσαι, τόσο πιο συκοφαντικό είναι το μοντέλο», είπε ο Daniel Khashabi, επίκουρος καθηγητής επιστήμης υπολογιστών στο Johns Hopkins. Είπε ότι είναι δύσκολο να γνωρίζουμε αν η αιτία είναι «τα chatbots που αντικατοπτρίζουν τις ανθρώπινες κοινωνίες» ή κάτι διαφορετικό, «επειδή πρόκειται για πραγματικά, πραγματικά πολύπλοκα συστήματα».

Το Sycophancy είναι τόσο βαθιά ενσωματωμένο στα chatbots που ο Cheng είπε ότι μπορεί να απαιτήσει από τις εταιρείες τεχνολογίας να επιστρέψουν και να εκπαιδεύσουν εκ νέου τα συστήματά τους AI για να προσαρμόσουν τους τύπους των απαντήσεων που προτιμώνται.

Σχετικά: Έρχονται ιατρικά Chatbots. Εδώ είναι τι πρέπει να γνωρίζετε πριν χρησιμοποιήσετε ένα.

Ο Cheng είπε ότι μια απλούστερη λύση θα μπορούσε να είναι εάν οι προγραμματιστές τεχνητής νοημοσύνης δίνουν εντολή στα chatbot τους να προκαλούν περισσότερο τους χρήστες τους, όπως ξεκινώντας μια απάντηση με τις λέξεις, “Περιμένετε ένα λεπτό”. Ο συν-συγγραφέας της Lee είπε ότι υπάρχει ακόμη χρόνος για να διαμορφώσουμε τον τρόπο με τον οποίο η τεχνητή νοημοσύνη αλληλεπιδρά μαζί μας.

«Θα μπορούσατε να φανταστείτε μια τεχνητή νοημοσύνη που, εκτός από την επικύρωση του πώς νιώθετε, ρωτά επίσης τι μπορεί να αισθάνεται ο άλλος», είπε ο Lee.

“Ή αυτό λέει, ίσως, “Κλείσε το” και πήγαινε να μιλήσεις αυτοπροσώπως. Και αυτό έχει σημασία γιατί η ποιότητα των κοινωνικών μας σχέσεων είναι ένας από τους ισχυρότερους προγνωστικούς παράγοντες για την υγεία και την ευημερία που έχουμε ως άνθρωποι. Τελικά, θέλουμε τεχνητή νοημοσύνη που διευρύνει την κρίση και τις προοπτικές των ανθρώπων αντί να την περιορίζει.”